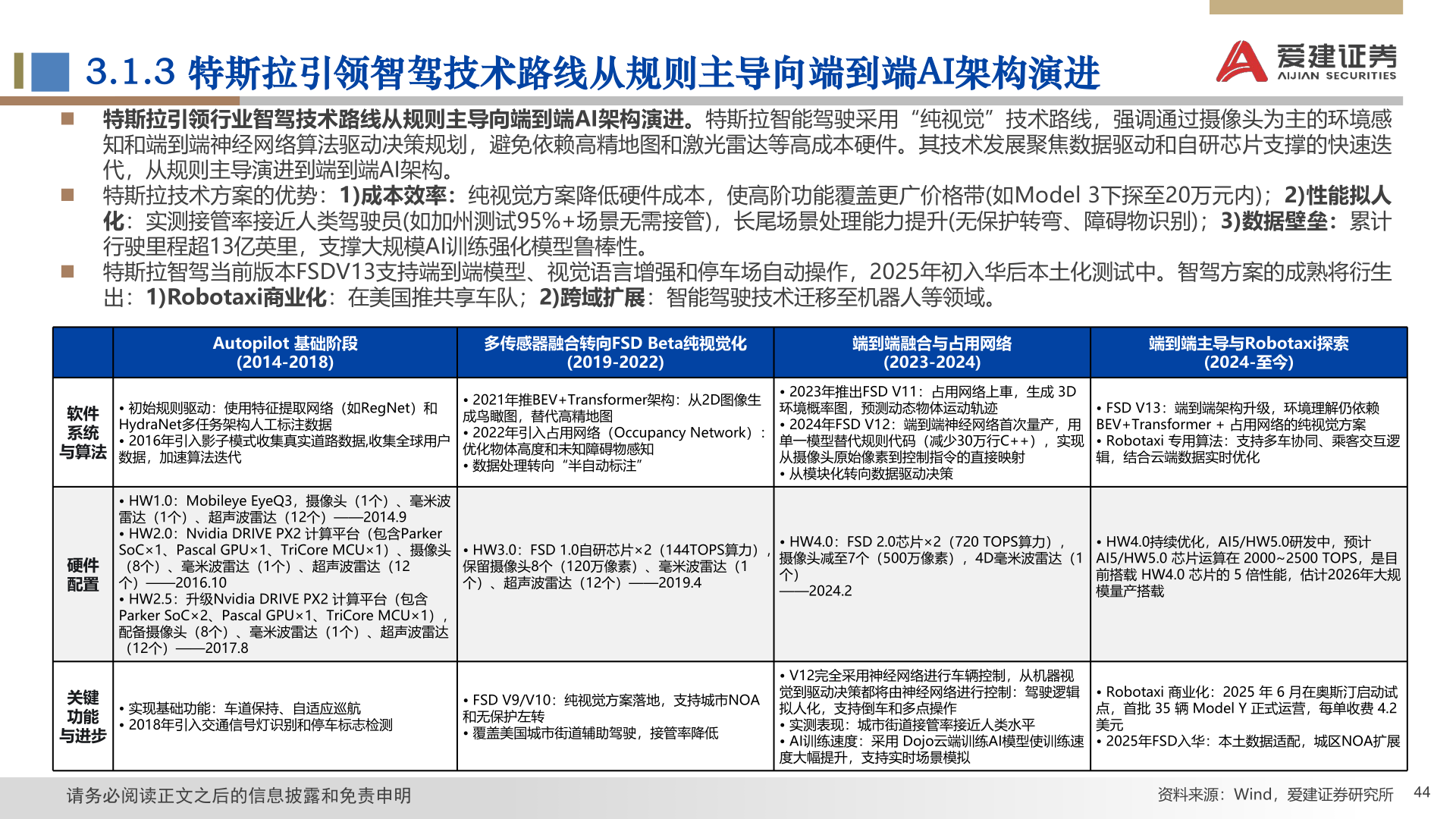

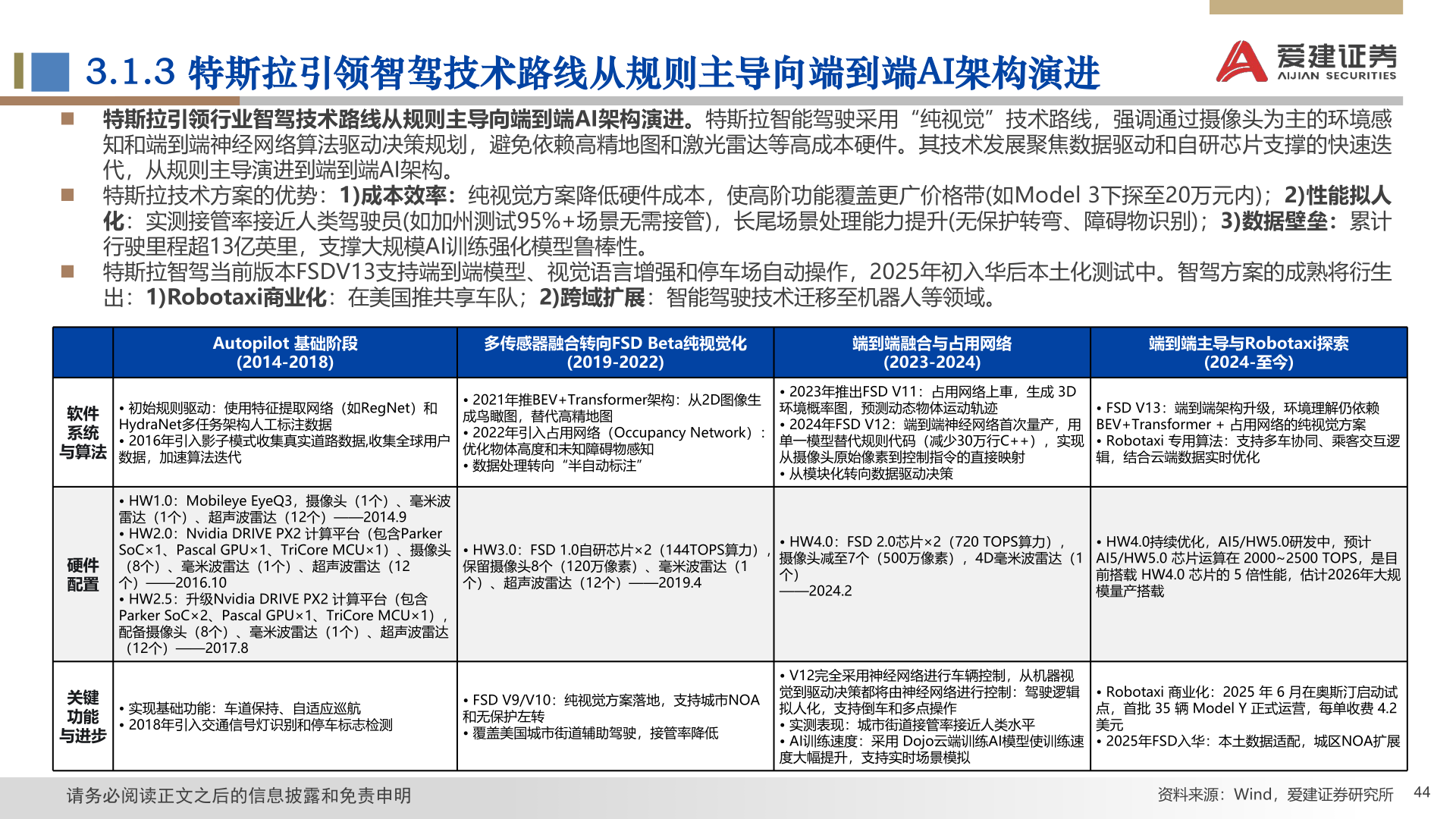

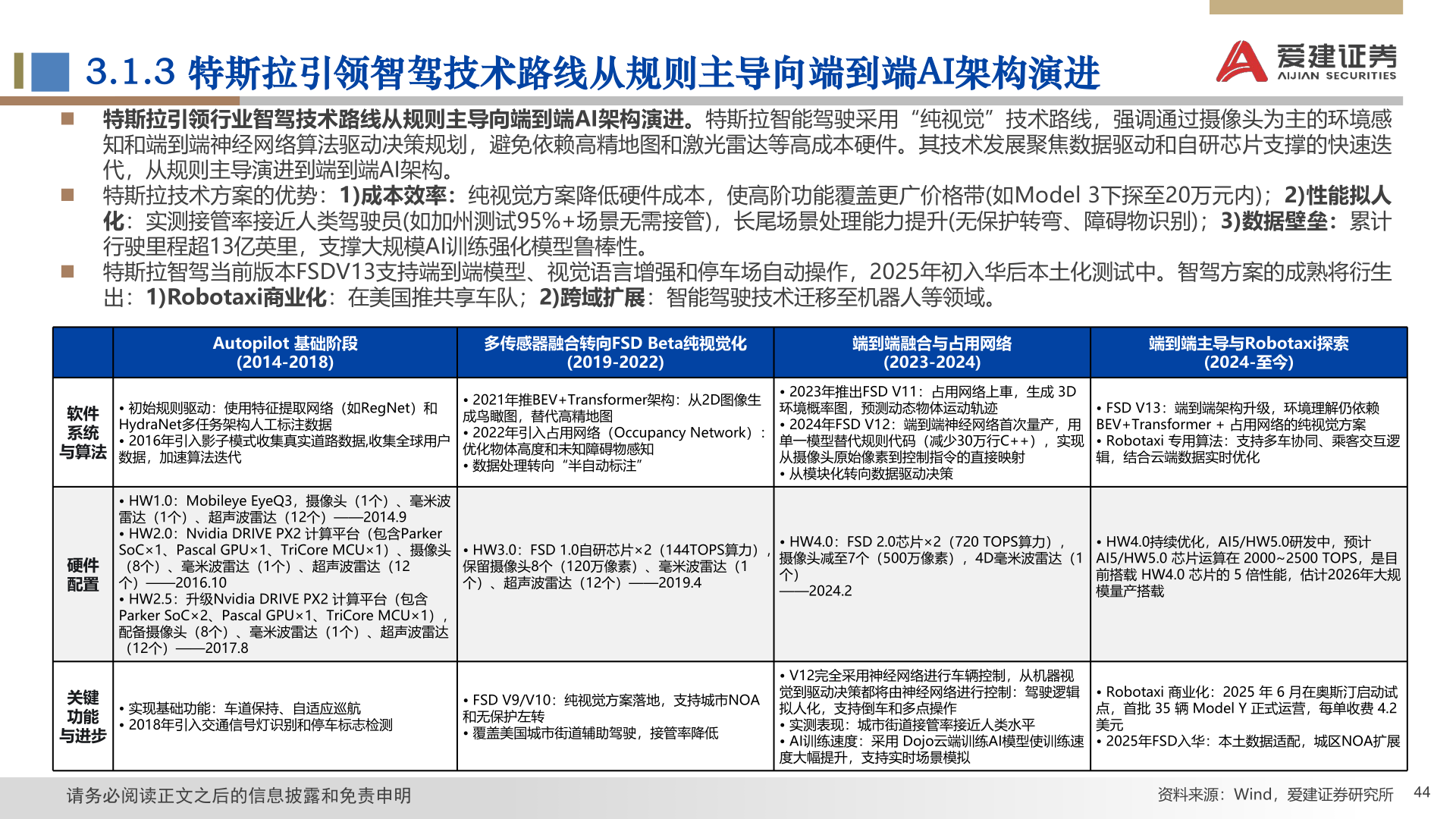

> 数据图表一起讨论下3.1.3 特斯拉引领智驾技术路线从规则主导向端到端AI架构演进

2025-9-4